Künstliche Intelligenz

In KI-Hardware investieren: Von CPUs bis XPUs

Securities.io hält strenge redaktionelle Standards ein und erhält möglicherweise eine Vergütung für geprüfte Links. Wir sind kein registrierter Anlageberater und dies stellt keine Anlageberatung dar. Bitte beachten Sie unsere Affiliate-Offenlegung.

In KI-Hardware investieren: Picks and Shovels-Ansatz

KI dürfte die bedeutendste Veränderung unserer Wirtschaft, unserer Produktionssysteme und unserer Gesellschaft in den letzten Jahrzehnten werden und könnte im Vergleich dazu sogar die radikalen Veränderungen, die das Internet mit sich bringt, trivial erscheinen lassen.

Dies könnte zum Verschwinden einer ganzen Kategorie von Berufen führen, darunter Fahrer, Übersetzer, Kundenbetreuer, Webdesigner usw. Andere Berufe könnten einen radikalen Rückgang der Nachfrage verzeichnen, etwa die des Programmierers, der Rechtsanwälte auf Einstiegsniveau, der Diagnostiker usw.

Darüber hinaus dürfte es für viele andere Aufgaben einen erheblichen Mehrwert und eine höhere Produktivität schaffen, wobei die führenden KI-Softwareunternehmen wahrscheinlich als erste eine Marktkapitalisierung erreichen werden, die zuvor unvorstellbar war.

Aus all diesen Gründen sind die Kapitalmärkte und Investoren von der KI fasziniert und verfolgen mit großer Aufmerksamkeit die Fortschritte der vielen Tech-Giganten im KI-Bereich sowie die starke Konkurrenz durch chinesische Tech-Giganten wie Alibaba und Startups wie DeepSeek.

Eine andere Möglichkeit, den KI-Boom auszunutzen, besteht darin, der bekannten Strategie zu folgen, die bei jedem Goldrausch funktioniert: nicht nach Gold suchen, sondern die Spitzhacken und Schaufeln verkaufen. Dies hat sich sicherlich für die Unternehmen bewährt, die zufällig am besten positioniert waren, um KI-optimierte Hardware zu verkaufen, mit Nvidia (NVDA ) Es hat seine Gaming-Grafikkarten in KI-Trainingschips verwandelt und ist damit das wertvollste Unternehmen der Welt. Die Marktkapitalisierung hat die erstaunliche Marke von 4 Billionen US-Dollar überschritten (Folgen Sie dem Link für einen vollständigen Bericht über Nvidia).

Da KI sehr spezielle Hardware erfordert, die sich größtenteils von anderen bisherigen Formen von Computeraufgaben unterscheidet, und eine enorme Geschäftschance darstellt, befindet sich die Halbleiterindustrie derzeit in einem Wettlauf um die Entwicklung neuer Formen von Hardware, die speziell für das Training und die Ausführung von KI-Programmen konzipiert ist.

Während Nvidia wahrscheinlich eines der Top-Unternehmen in der Branche bleiben wird, zeichnen sich nun Alternativen ab, die für Anleger, die frühzeitig aufpassen, interessante Möglichkeiten bieten könnten.

Warum KI spezielle Hardware benötigt

Viele kleine Berechnungen

Die ersten KI-Entwicklungen nutzten die gleiche Rechenkapazität wie andere Programme und konzentrierten sich hauptsächlich auf Prozessoren (Central Processing Units, CPUs). CPUs sind zwar nach wie vor wichtig, doch schnell stellte sich heraus, dass sie für die meisten der heute zur Entwicklung von KI verwendeten Methoden nicht optimal geeignet sind.

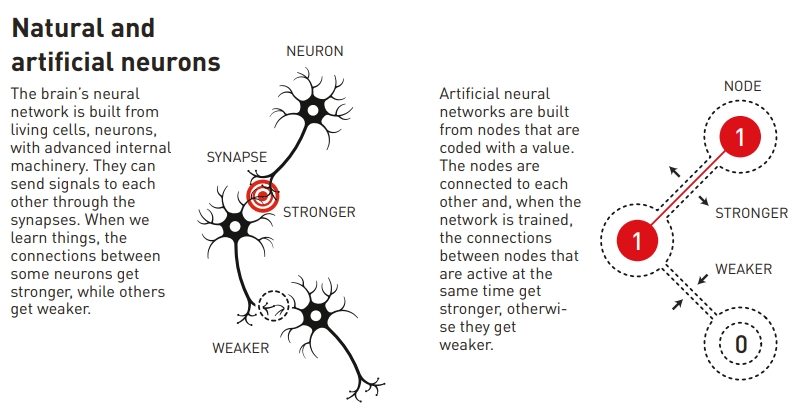

Neuronale Netzwerke und ähnliche Methoden erfordern viele relativ einfache Berechnungen anstelle einer einzigen sehr komplexen Berechnung. Daher ist die parallele Arbeit vieler kleiner Chips im Allgemeinen besser als die Arbeit auf riesigen und leistungsstarken CPUs.

Dies ist zu einem großen Teil der Grund dafür, dass GPUs schnell immer beliebter wurden, da Grafikkarten von Natur aus darauf ausgelegt sind, Tausende kleinerer Berechnungen parallel durchzuführen.

Das heutige KI-Training basiert größtenteils auf neuronalen Netzwerken, ein Konzept, das 2024 mit dem Nobelpreis für Physik ausgezeichnet wurde, eine Auszeichnung, die wir damals in einem eigenen Artikel ausführlich behandelt haben.

Quelle: Nobelpreis

Eine zweite Revolution in der KI-Technologie kam mit „Transformern“. Sie lösen traditionelle neuronale Netzwerke Unfähigkeit, lange Datensequenzen effizient zu verarbeiten, ein gemeinsames Merkmal jeder natürlichen Sprache.

Es wurde 2017 erstmals von Google-Forschern vorgestellt und ist die Hauptursache für die aktuelle Explosion der KI-Kapazität. Transformer bilden den Kern von KI-Produkten wie LLMs (Large Language Models), einschließlich ChatGPT.

Unterschiedliche Anforderungen

Ein wichtiger Unterschied in KI-Workflows ist der Unterschied zwischen Feintuning und Inferenz, die beide unterschiedliche Hardwareanforderungen haben.

- Feintuning beinhaltet das Trainieren eines Modells anhand domänenspezifischer Daten, was erhebliche Rechenleistung und Speicher erfordert. Es handelt sich um eine sehr technische Aufgabe, die oft an der äußersten Grenze der KI-Wissenschaft liegt.

- Inferenz konzentriert sich auf die Verwendung eines bereits trainierten Modells zur Generierung von Ausgaben, erfordert weniger Rechenleistung, legt aber einen stärkeren Fokus auf geringe Latenz und Kosteneffizienz.

- Dies geschieht häufiger durch KI-Experten, die bereits vorhandene Modelle einsetzen, um reale Probleme zu lösen.

Während also die Kosten sowohl bei der Feinabstimmung/Schulung als auch bei der Inferenz/Verwendung von KI offensichtlich ein Problem darstellen, erfordert die Schulung oft die bestmögliche Hardware, während bei Nutzungsaufgaben der Schwerpunkt bei der Auswahl der besten Hardwareoption eher auf den Hardwarekosten und dem Energieverbrauch liegt.

CPUs vs. GPUs

Zentraleinheiten (CPUs):

CPUs sind Allzweck- und keine spezielle KI-Hardware. Sie sind jedoch dennoch für die Ausführung von Anweisungen und die Durchführung grundlegender Berechnungen in KI-Systemen unerlässlich.

Auch die meiste Software, die die Schnittstelle zu den Endbenutzern eines KI-Systems handhabt, wird CPU-zentriert sein, seien es einzelne Computer oder Cloud-basierte Software.

Quelle: AnandTech

CPUs können auch für sehr einfache KIs verwendet werden, für die keine dedizierte Hardware erforderlich ist. Dies gilt insbesondere dann, wenn die Ausgabe nicht besonders dringend ist und die relativ langsamere KI-Verarbeitung von CPUs kein Problem darstellt.

Kleine Modelle mit kleinen Datenmengen und Berechnungen können also auf CPUs gut laufen. Die Allgegenwärtigkeit von CPUs in herkömmlichen Computern macht sie auch für Durchschnittsnutzer zu einer guten Option, die nicht in KI-spezifische Hardware investieren möchten.

CPUs sind außerdem sehr zuverlässig und stabil, was sie zu einer guten Wahl für kritische Aufgaben macht, bei denen Fehlerfreiheit ein wichtiges Kriterium ist.

Und schließlich sind CPUs für einige Aufgaben beim KI-Training nützlich, im Allgemeinen in Zusammenarbeit mit anderen Arten von Hardware, etwa zum Laden, Formatieren, Filtern und Visualisieren von Daten.

Grafikprozessoren (GPUs):

GPUs wurden ursprünglich für die Grafikwiedergabe entwickelt und sind auf die parallele Verarbeitung ausgelegt. Damit eignen sie sich ideal für das Training von KI-Modellen, die große Datensätze verarbeiten müssen. Der Wechsel von CPUs zu GPUs hat die Trainingszeiten von Wochen auf Stunden verkürzt.

Aufgrund ihrer weiten Verbreitung und der Erfahrung der IT-Spezialisten im Umgang mit ihnen waren GPUs die erste Art von Computerhardware, die serienmäßig installiert wurde, um die KI-Forschung voranzutreiben.

Quelle: Aorus

Ebenfalls maßgeblich zum Erfolg der GPUs beigetragen hat die Entwicklung von CUDA durch Nvidia, einer universellen Programmierschnittstelle für NVIDIAs GPUs, die den Weg für andere Einsatzmöglichkeiten als Spiele ebnete. Dies geschah, weil einige Forscher bereits GPUs anstelle der üblichen Supercomputer für Berechnungen nutzten.

„Forscher haben festgestellt, dass man durch den Kauf dieser Gaming-Karte namens GeForce, die man zu seinem Computer hinzufügt, im Wesentlichen einen persönlichen Supercomputer besitzt.

Molekulardynamik, seismische Verarbeitung, CT-Rekonstruktion, Bildverarbeitung – eine ganze Reihe verschiedener Dinge.“

Auch heute noch gehören GPUs zu den gefragtesten KI-Hardwaretypen, und Nvidia schafft es kaum, genug davon zu produzieren, um die Nachfrage der Technologiegiganten zu befriedigen, die KI-Rechenzentren im Gigawatt-Bereich bauen.

Es ist auch der Beginn der „Super-GPU-Ära“, mit der kürzlichen Veröffentlichung von Nvidia von der GB200 NVL72.

Diese Hardware ist so konzipiert, dass sie ab Werk als einzelne massive GPU fungiert, anstatt viele kleine vernetzen zu müssen. Dadurch ist sie sogar noch leistungsstärker als das bisher rekordverdächtige Modell H100.

Quelle: Nvidia

Dies dürfte zudem deutlich energieeffizienter sein, ein entscheidender Punkt, da die KI-Industrie angesichts der Geschwindigkeit, mit der KI-Rechenzentren gebaut werden, möglicherweise zunächst Energiemangel und dann einen Mangel an Chips haben könnte. Mehr Rechenleistung und Energieeffizienz bedeuten zudem weniger Abwärme, was auch das Überhitzungsproblem vorübergehend löst.

| Hardwaretyp | Bester Anwendungsfall | Schnelligkeit | Energieeffizienz | Flexibilität |

|---|---|---|---|---|

| CPU | Allgemeine Aufgaben | Niedrig | Hoch | Sehr hoch |

| GPU | KI-Training und parallele Aufgaben | Hoch | Medium | Medium |

| TPU | Tensoroperationen und Transformatoren | Sehr hoch | Hoch | Niedrig |

| ASIC | Beschleunigung einzelner Aufgaben | Sehr hoch | Sehr hoch | Sehr niedrig |

| FPGA | Rekonfigurierbare KI-Workloads | Medium | Medium | Hoch |

Der Aufstieg von ASICs und KI-Hardware

Anwendungsspezifische integrierte Schaltkreise (ASICs) sind Computerhardware, die speziell für eine bestimmte Computeraufgabe entwickelt wurde und damit noch spezialisierter ist als die noch relativ allgemeinen GPUs.

Sie sind daher weniger flexibel und programmierbar als Allzweckhardware.

Sie sind in der Regel komplexer und zudem meist teurer, da bei ihrer Produktion keine Skaleneffekte erzielt werden und die Kosten für kundenspezifische Designs höher sind.

Sie sind jedoch bei der Erfüllung ihrer jeweiligen Aufgabe wesentlich effizienter und erzeugen normalerweise schneller ein Ergebnis, wobei wesentlich weniger Rechenleistung und Energie verschwendet wird.

ASICs und andere KI-spezifische Hardware werden immer häufiger eingesetzt, da in diesem Bereich zunehmend erkannt wird, dass manche Berechnungen nicht idealerweise auf GPUs durchgeführt werden, sondern speziellere Geräte erfordern.

Tensor-Verarbeitungseinheiten (TPUs)

TPUs wurden von Google entwickelt (GOOGL ) speziell für die Durchführung von Tensorberechnungen (verbunden mit transformatorbasierter Analysis). Sie sind für Arithmetik mit hohem Durchsatz und geringer Genauigkeit optimiert.

Quelle: C#Corner

Dies verleiht TPUs eine hohe Leistung, Effizienz und Skalierbarkeit für das Training großer neuronaler Netzwerke.

TPUs verfügen über spezielle Funktionen wie die Matrix Multiply Unit (MXU) und eine proprietäre Verbindungstopologie, die sie ideal für die Beschleunigung von KI-Training und -Inferenz machen.

TPUs sind die Grundlage für Gemini und alle KI-gestützten Anwendungen von Google wie Suche, Fotos und Karten und werden von über einer Milliarde Nutzern genutzt.

Dieser Hardwaretyp kann die Entwicklung und Funktionsweise neuronaler Netzwerke erheblich beschleunigen, wobei gelegentliche Fehler weniger ins Gewicht fallen, da diese Modelle von vornherein stark auf Statistiken und einer großen Anzahl von Berechnungen beruhen.

Zu den Endbenutzeraufgaben, die sich am besten für TPUs eignen, zählen Deep Learning, Spracherkennung und Bildklassifizierung.

Neuronale Netzwerkprozessoren (NNPs):

NPPs sind ebenfalls mit Neural Processing Units (NPUs) verknüpft und werden als neuromorphe Chips bezeichnet. Sie sind auf die Berechnung neuronaler Netzwerke spezialisiert und sollen die neuronalen Verbindungen im menschlichen Gehirn nachahmen. Sie werden manchmal auch als KI-Beschleuniger bezeichnet, obwohl dieser Begriff weniger klar definiert ist.

Eine NPU integriert außerdem Speicherung und Berechnung durch synaptische Gewichte. So kann sie sich im Laufe der Zeit anpassen oder „lernen“, was zu einer verbesserten Betriebseffizienz führt.

Eine NPU umfasst spezielle Module für Multiplikation und Addition, Aktivierungsfunktionen, 2D-Datenoperationen und Dekomprimierung.

Das spezialisierte Multiplikations- und Additionsmodul wird verwendet, um Operationen auszuführen, die für die Verarbeitung von neuronalen Netzwerkanwendungen relevant sind, wie z. B. die Berechnung von Matrizenmultiplikation und -addition, Faltung, Skalarprodukt und anderen Funktionen.

Durch die Spezialisierung kann eine NPU eine Operation mit nur einer Berechnung abschließen, anstatt mit mehreren tausend Berechnungen wie bei einer generalistischen Hardware. Zum Beispiel: IBM behauptet, dass NPU die Effizienz von KI-Berechnungen im Vergleich zu GPUs radikal verbessern kann.

„Tests haben gezeigt, dass die Leistung einiger NPUs bei gleichem Stromverbrauch über 100-mal besser ist als die einer vergleichbaren GPU.“

Aufgrund dieser Energieeffizienz werden NPUs von Herstellern gerne in Benutzergeräte eingebaut, wo sie bei der lokalen Ausführung von Aufgaben für generative KI-Apps helfen können, ein Beispiel für „Edge Computing“. (Weitere Informationen zu diesem Thema finden Sie weiter unten.)

Zurzeit werden zahlreiche Methoden zur Herstellung neuromorpher Chips erforscht:

- Nutzen Sie die beginnende Ferroelektrizität, ein noch immer schlecht verstandenes Phänomen.

- Aktives Substrat aus Vanadium oder Titan.

- Verwendung von Memristoren, ein neuartiges elektronisches Bauteil, das Führen Sie KI-Aufgaben mit 1/800 austhdes normalen Stromverbrauchs.

AHilfsmittel PVerarbeitung UNisse (XPUs)

XPU vereint CPU (Prozessor), GPU (Grafikkarte/Parallelprozessoren) und Speicher im selben elektronischen Gerät.

Quelle: Broadcom

XPUs ist ein weit gefasster Begriff, der viele Variationen dieses Konzepts umfasst, die gesamte Hardware in eigenständigen Einheiten unterzubringen, darunter Datenverarbeitungseinheiten (DPUs), Infrastrukturverarbeitungseinheiten (IPUs), und Funktionsbeschleunigerkarten (FACs).

XPUs gelten als Lösung für ein wachsendes Problem von KI-Rechenzentren, nämlich den wachsenden Bedarf an Konnektivität zwischen den Untereinheiten, bis hin zu dem Punkt, an dem die Datenverzögerung zu einem wichtigeren Faktor für die Verlangsamung der Datenverarbeitung wird, der die verfügbare Rechenleistung übersteigt.

Im Wesentlichen warten die Chips (GPUs, TPUs, NPPs usw.) genauso lange auf die Daten, wie sie tatsächlich arbeiten.

Ein führender Anbieter dieser Technologie ist Broadcom (AVGO ), Die Wir haben dies ausführlich in einem speziellen Anlagebericht besprochen..

Field-Programmable Gate Arrays (FPGAs):

FPGAs sind programmierbare Prozessoren und daher deutlich flexibler und rekonfigurierbarer als die starreren ASICs. FPGAs können für bestimmte KI-Algorithmen angepasst werden und bieten so potenziell höhere Leistung und Energieeffizienz.

Quelle: Mikrocontroller-Labore

Die Flexibilität hat ihren Preis, da FPGAs im Allgemeinen komplexer und teurer sind und mehr Strom verbrauchen. Sie können jedoch immer noch effizienter sein als allgemeine Hardware.

Dies macht sie zu einem Nischenprodukt, bei dem ihre Flexibilität die Nachteile ausgleicht. Beispielsweise können maschinelles Lernen, Computer Vision und die Verarbeitung natürlicher Sprache von der Vielseitigkeit der FPGAs profitieren.

Speicher mit hoher Bandbreite (HBM):

Die wichtigsten Entwicklungen bei kundenspezifischer KI-zentrierter Hardware fanden im Bereich der Rechenleistung statt, die lange Zeit der Engpass beim Aufbau weiterer Rechenkapazitäten zum Trainieren neuer KIs war.

Dennoch benötigen diese Systeme auch hocheffiziente Unterstützungssysteme, von denen der Speicher ein wichtiger ist. HBM bietet, wie der Name schon sagt, eine höhere Bandbreite als herkömmliches DRAM.

Dies wird erreicht, indem mehrere DRAM-Chips vertikal gestapelt und mit Through-Silicon-Vias (TSVs) verbunden werden. Die erste Generation von HBM wurde 2013 entwickelt.

Die vertikale Stapelung spart Platz und verringert die physische Distanz, die die Daten zurücklegen müssen. Dadurch wird die Datenübertragung beschleunigt, was in der KI-Datenverarbeitung unerlässlich ist.

Die Herstellung von HBMs ist komplexer und teurer als die von DRAM, aber die Vorteile hinsichtlich Leistung und Energieeffizienz rechtfertigen oft die höheren Kosten für KI-Anwendungen.

KI-Rechenzentrumsinfrastruktur: Stromversorgung, Kühlung und Konnektivität

Neben Speicher und Rechenleistung sind auch die Zusatzsysteme von KI-Rechenzentren wichtig. Ohne sie können die Daten nicht schnell genug zirkulieren, die Chips würden überhitzen oder die zur Verfügung stehende Leistung würde nicht ausreichen.

Dies bedeutet, dass beispielsweise auch die Konnektivitätshardware von Broadcom stark vom Aufbau von KI-Rechenzentren profitiert, ebenso wie spezialisierte Lösungen wie Anbieter von Kühlgeräten, beispielsweise Vertiv (VRT ) oder Schneider Electric (SU.PA).

Auch die Stromversorgung könnte zum Problem werden, und mehrere Technologiegiganten versuchen, dieses Problem zu lösen, indem sie auf Kernenergie setzen. mit dem ersten Schritt von Microsoft im Jahr 2024, gefolgt von vielen anderen seitdem.

In Kombination mit der Verpflichtung der Technologieunternehmen, den CO2-Fußabdruck ihrer KI zu verringern, dürfte dies Unternehmen im Kernenergie- oder erneuerbaren Energiesektor große Vorteile bringen, wie beispielsweise Cameco (CCJ ), GE Vernova (GEV ), First Solar (FSLR ), NextEra (NEE )den Brookfield Energiepartner (BEP ) (Folgen Sie den Links, um einen Bericht zu jedem Unternehmen zu erhalten).

Neue KI-Computertechnologien

Quanten-Computing

Da KI so viel Rechenleistung benötigt, ist es möglich, dass die Zukunft der Hardware in diesem Bereich nicht einmal mit den derzeit verfügbaren Siliziumlösungen erreicht werden kann.

Eine Möglichkeit besteht darin, dass Quantencomputer verwendet werden könnten, um Muster viel effizienter zu erkennen, als dies mit klassischen Computern jemals möglich wäre. etwas, das bereits von Forschern erforscht wurde.

Quantencomputing könnte zur Lösung spezifischer Berechnungen eingesetzt werden, die mit binären Berechnungen nahezu unmöglich sind. Dies wird wahrscheinlich letztendlich auch in der KI Anwendung finden, doch die ersten kommerziellen Quantencomputer werden noch einige Jahre auf sich warten lassen, und ein großes Quantennetzwerk wird noch viel weiter entfernt sein.

Photonics

Durch die Verwendung von Licht anstelle von Elektronen zur Datenübertragung könnte die Photonik viel schneller sein als elektronische Geräte.

Da Quantencomputer normalerweise Quantendaten mit verschränkten Photonen übertragen, gibt es auch viele Überschneidungen zwischen Quantencomputing und Photonik, und der erste duale Quantenphotonik-Chip wurde bereits angekündigt.

Organoide

Da die Funktionsweise der neuronalen Netzwerke des Gehirns in den meisten Fällen durch KI-Systeme nachgebildet wird, fragen sich einige Forscher, ob wir nicht stattdessen … echte Gehirnzellen verwenden könnten.

Dies ist eine faszinierende Idee, insbesondere Einige Forschungsergebnisse könnten darauf hinweisen, dass das Gehirn tatsächlich ein organischer Quantencomputer ist.

Diese Art von „Computer“ wird als Organoid bezeichnet und besteht im Wesentlichen aus Neuronen, die im Labor auf einem Computerchip gezüchtet werden. Die Neuronen organisieren dann ihre Dendriten und Verbindungen als Reaktion auf den Chip-Stimulus selbst.

Diese Technologie ist noch neu und basiert auf Bio-3D-Druck.

Sonstiges

Wir haben andere Alternativen zum Silizium-Computing in „Top 10 der Nicht-Silizium-Computerunternehmen“, wie Vanadiumdioxid, Graphen, Redox-Gating oder organische Materialien.

Jedes dieser Verfahren verspricht, entweder deutlich schneller oder deutlich weniger energieintensiv zu sein als die klassische Silizium-basierte Computertechnik. Allerdings sind sie noch relativ neu und werden den Bereich der KI zumindest in den nächsten fünf bis zehn Jahren wahrscheinlich nicht im kommerziellen Maßstab revolutionieren.

Cloud-KI und Edge-KI: Trends zur Barrierefreiheit

Cloud-KI

Da die leistungsstärksten KI-Systeme von großen Technologieunternehmen entwickelt werden, sind sie meist über die Cloud zugänglich. Dasselbe gilt zunehmend auch für den Zugriff auf KI-spezialisierte Hardware selbst.

Der Anführer dieses Trends ist Kerngewebe (CRCW ), ein Unternehmen, das vom Cloud-Anbieter zum Kryptowährungs-Mining mithilfe von GPUs wechselte und heute KI-Computing auf Abruf anbietet.

Dies machte CoreWeave zu einem wichtigen Partner aufstrebender KI-Startups, die versuchen, mit den Technologiegiganten zu konkurrieren, wie Flexion AI und sein GPU-Cluster im Wert von 1.3 Milliarden US-Dollar, finanziert durch eine neue Finanzierungsrunde.

„Vor zwei Monaten existierte ein Unternehmen vielleicht noch nicht, und heute verfügt es möglicherweise über 500 Millionen US-Dollar Risikokapital.

Und das Wichtigste für sie ist, den Zugriff auf die Computer zu sichern. Erst wenn sie diesen Zugang haben, können sie ihr Produkt oder ihr Geschäft auf den Markt bringen.“

Da die reinen KI-Hardware-Player zunehmend misstrauisch gegenüber den großen Technologieunternehmen werden, die ihre eigenen GPUs, TPUs, XPUs usw. produzieren und sich vom Kunden zum Konkurrenten entwickeln, ist es wahrscheinlich, dass Unternehmen wie CoreWeave vorrangigen Zugriff auf die neuste Hardware-Version von Nvidia und anderen erhalten.

Dieses Geschäftsmodell dürfte insbesondere für das KI-Training von Bedeutung sein, da dieses weitaus höhere Rechenkapazitäten erfordert als die bloße Nutzung bereits trainierter KIs.

Edge Computing und KI-PCs

Ein weiterer Fall von KI-Computing, der sich schnell weiterentwickelt, ist die Notwendigkeit, die Berechnung von KI-Systemen vor Ort und so nah wie möglich an realen Situationen durchzuführen.

Dies ist ein Muss für Systeme, die es möglicherweise nicht tolerieren, von der KI getrennt zu werden, wenn die Verbindung fehlschlägt oder die Latenz beim Hin- und Her-Datenaustausch mit der Cloud zu gering ist.

Ein gutes Beispiel sind selbstfahrende Autos, von denen erwartet wird, dass sie ihre Umgebung offline erfassen.

Diese Art der Berechnung wird als Edge Computing bezeichnet und profitiert stark von effizienterer und weniger stromhungriger Hardware.

Es kann die Zuverlässigkeit der KI erhöhen und da die Modelle effizienter werden, wie der große Fortschritt von DeepSeek zeigt, könnte es in Zukunft ein weiter verbreitetes Modell für den Einsatz von KI werden.

Aus dem gleichen Grund wie das kürzlich von Nvidia eingeführte, könnte auf lange Sicht ausreichen, um viele KI-Anwendungen lokal auszuführen, wodurch Datenschutz und Sicherheit im Vergleich zu KIs, die ständig mit der Cloud verbunden sind, erhöht werden.

Fazit

KI-Hardware war lange Zeit ein Synonym zu GPUs, da Grafikkarten beim KI-Training deutlich effizienter waren als andere Hardwaretypen wie CPUs. Dies begründete das Vermögen von Nvidia und vielen seiner frühen Aktionäre.

GPUs, insbesondere KI-fokussierte „Super-GPUs“, werden beim Aufbau von KI-Rechenzentren wahrscheinlich weiterhin eine wichtige Rolle spielen. Sie werden sich jedoch zu einer Komponente zunehmend komplexer und spezialisierter Systeme entwickeln.

Transformatorvorgänge werden an TPUs gesendet, neuronale Netzwerke, die NPP zugewiesen sind, und sich wiederholende Aufgaben werden an dedizierte ASICs oder neu konfigurierte FPGAs gesendet.

Gleichzeitig sorgen Speicher mit hoher Bandbreite, fortschrittliche Telekommunikationsanschlüsse und eine hocheffiziente Kühlung dafür, dass alle Zusatzfunktionen rund um den Rechenkern am Laufen bleiben.

Für Edge Computing und kleinere KIs als die riesigen LLMs wird lokales Computing, möglicherweise angetrieben durch All-in-One-XPUs, wahrscheinlich von Wissenschaftlern, selbstfahrenden Autos und Benutzern verwendet, denen Datenschutz oder Zensur am Herzen liegen, möglicherweise mit Open-Source-KI-Modellen.

Sicher ist, dass die Gewinne aus dem Verkauf von KI-Hardware im Rahmen des KI-Goldrauschs noch lange nicht vorbei sind.

Nach einer Phase der Dominanz von Nvidia möchten Investoren möglicherweise ihre Risiken streuen, indem sie ihr KI-Hardware-Portfolio auf andere Designs ausweiten und vielleicht sogar die Energieversorgungsunternehmen einbeziehen, die die wertvollen Gigawatt für den Betrieb der immer größer und zahlreicher werdenden KI-Rechenzentren auf der Welt bereitstellen.