Computing

Komputery kwantowe osiągają bezwarunkowe przyspieszenie wykładnicze

To, co wcześniej wyrażano tylko na papierze, teraz zostało zademonstrowane w działaniu. Obietnica komputerów kwantowych została w rzeczywistości spełniona, ponieważ pokonać klasyczne komputery wykładniczo i bezwarunkowo1.

W tym celu zespół badaczy pod przewodnictwem Daniela Lidara, profesora inżynierii elektrycznej i komputerowej w USC Viterbi School of Engineering, wykorzystał inteligentną korekcję błędów i wydajne 127-kubitowe procesory IBM, które pozwoliły im na uzyskaniejest odmianą problemu Simona, pokazującą, że maszyny kwantowe uwalniają się obecnie od klasycznych ograniczeń.

Jak komputery kwantowe pokonują klasyczne ograniczenia i szum

Przez dziesięciolecia klasyczne obliczenia były normą. Jednak w ostatnich latach informatyka kwantowa uległ znacznemu rozwojowi.

Komputery kwantowe to rozwijająca się dziedzina informatyki, która wykorzystuje zasady teorii kwantowej (objaśniającej naturę i zachowanie materii i energii na poziomie atomowym i subatomowym) w celu znacznego zwiększenia szybkości obliczeń.

Wykorzystując fizykę kwantową, obliczenia kwantowe mają na celu rozwiązywanie problemów, które są zbyt złożone dla klasycznych komputerów, których używamy na co dzień. W rzeczywistości obliczenia kwantowe mogą rozwiązywać pewne złożone problemy symulacyjne, które nawet tradycyjnemu superkomputerowi zajęłyby setki tysięcy lat.

Osiągnięcie rzeczywistej przewagi algorytmicznej nad komputerami klasycznymi jest jednym z kluczowych celów komputerów kwantowych. Umożliwi to dokonywanie przełomów w chemii, kryptografii, optymalizacji i innych dziedzinach.

Wymaga to jednak specjalistycznego sprzętu do obliczeń kwantowych i algorytmów, które wykorzystują właściwości kwantowe, takie jak superpozycja i splątanie. Ponadto szum jest poważnym problemem dla komputerów kwantowych.

Co więcej, udowodnienie przewagi algorytmicznej nad komputerami klasycznymi przy użyciu dzisiejszego niedoskonałego i zakłóconego sprzętu kwantowego pozostaje wyzwaniem.

Projektanci zaczęli badać nowe rozwiązania, takie jak maszyny NISQ, ale te szumne urządzenia kwantowe średniej skali (NISQ) działają na stosunkowo mała skala kilkuset kubitów.

Ponadto są one podatne na pogorszenie wydajności ze względu na dekoherencję (utratę spójności kwantowej, która wiąże się z utratą informacji o systemie i przekazywaniem jej do otoczenia) i błędy sterowania.

Tak więc nacisk położony jest na przyspieszenie algorytmicznego kwantowania na tych urządzeniach, co jest po prostu zaletą skalowania. Podczas gdy przeprowadzono kilka tego typu demonstracji, złożoność problemów wybranych w nich opierała się albo na trudności ograniczonego zestawu klasycznych algorytmów, albo na przypuszczeniach dotyczących złożoności obliczeniowej.

Niedawno w modelu wyroczni zaprezentowano algorytmiczne przyspieszenie obliczeń kwantowych, które nie opiera się na nieudowodnionych założeniach. Wykazano to w przypadku algorytmu Bernsteina-Vaziraniego, który zaobserwowano po wdrożeniu go na procesorze IBM Quantum z niepożądanym szumem wyeliminowanym za pomocą dynamicznego rozdzielania (DD), powszechnie stosowanej techniki eliminacji błędów w urządzeniach NISQ.

Teraz zespół badawczy z University of Southern California zajmuje się problemem szumu, wdrażając odmianę problemu Simona. Jest to dobrze znany przykład, w którym, teoretycznie, algorytmy kwantowe mogą rozwiązać zadanie wykładniczo szybciej niż ich klasyczne odpowiedniki, bezwarunkowo.

Problem Simona jest poprzednikiem algorytmu Shora, który może posłużyć jako początek dziedziny komputerów kwantowych.

Jest to również jeden z oryginalnych problemów, w którym udowodniono wykładniczy wzrost kwantowy, choć w modelu Oracle. Problem wymaga wykładniczego czasu do rozwiązania na klasycznym komputerze, ale na bezgłośnym komputerze kwantowym zajmuje tylko liniowy czas, zakładając, że zapytania Oracle są liczone, ale nie uwzględniamy zasobów, które są wydawane na jego wykonanie.

W tym problemie ukryta podgrupa abelowa obejmuje tożsamość i tajny ciąg b, a celem jest określenie b, czyli zasadniczo znalezienie ukrytego powtarzającego się wzoru w funkcji matematycznej.

Mówiąc prościej, jest to gra polegająca na zgadywaniu, w której gracze próbują odgadnąć tajną liczbę, o której nie wie nikt poza gospodarzem gry, czyli „wyrocznią”.

Święta liczba zostaje ujawniona, gdy gracz odgadnie dwie liczby, dla których odpowiedzi podane przez wyrocznię są identyczne, i ten gracz wygrywa. W porównaniu do klasycznych graczy, gracze kwantowi mogą wygrać tę grę wykładniczo szybciej.

Osiągnięcie bezwarunkowego przyspieszenia kwantowego

Aby za pomocą komputerów kwantowych można było rzeczywiście odkrywać nowe materiały, łamać kody i projektować nowe leki poprzez przyspieszenie obliczeń, muszą one być funkcjonalne.

Ale jak zauważyliśmy powyżej, szum lub błędy stają na drodze. Błędy, które powstają podczas obliczeń na maszynie kwantowej, sprawiają, że komputery kwantowe są jeszcze mniej wydajne niż komputery klasyczne. Tak było do tej pory.

Lidar z USC pracował nad kwantową korekcją błędów i wykazał przewagę skalowania kwantowego nad chmurą.

Zostało to szczegółowo opisane w artykule „Demonstration of Algorithmic Quantum Speedup for an Abelian Hidden Subgroup Problem”, nad którym firma Lidar współpracowała ze współpracownikami z USC i Johns Hopkins.

„Wcześniej były demonstracje skromniejszych typów przyspieszeń, takich jak przyspieszenie wielomianowe. Jednak przyspieszenie wykładnicze jest najbardziej dramatycznym typem przyspieszenia, jakiego spodziewamy się po komputerach kwantowych”.

- Poradzić sobie

Według Lidara, głównym przełomem w obliczeniach kwantowych jest wykazanie, że możemy faktycznie wykonywać całe algorytmy ze skalowalnym przyspieszeniem w stosunku do naszych zwykłych komputerów. Ale jak wyjaśnił, nie oznacza to, że można robić rzeczy 100 razy szybciej.

Jednak przyspieszenie skalowania oznacza, że „w miarę jak zwiększasz rozmiar problemu poprzez uwzględnienie większej liczby zmiennych, różnica między wydajnością kwantową a klasyczną stale rośnie. A przyspieszenie wykładnicze oznacza, że różnica w wydajności podwaja się z każdą dodatkową zmienną” – wyjaśnił Lidar.

Następnie stwierdził, że przyspieszenie, jakie wykazał zespół, jest „bezwarunkowe”. Oznacza to, że przyspieszenie nie zależy od żadnych niepotwierdzonych założeń.

Poprzednie twierdzenia o przyspieszeniu wymagały założenia, że nie istnieje lepszy klasyczny algorytm, z którym można by porównać algorytm kwantowy.

Zespół wykorzystał zmodyfikowany algorytm komputera kwantowego, aby rozwiązać pewną odmianę „problemu Simona”.

Teraz, aby osiągnąć wykładniczy wzrost prędkości, „kluczem jest wyciśnięcie każdej uncji wydajności ze sprzętu: krótsze obwody, inteligentniejsze sekwencje impulsów i statystyczne ograniczanie błędów” – zauważa główny autor Phattharaporn Singkanipa, który jest doktorantem na USC.

Zespołowi udało się to osiągnąć na cztery różne sposoby. Naukowcy najpierw ograniczyli ilość wprowadzanych danych, ograniczając liczbę dozwolonych tajnych liczb. Technicznie rzecz biorąc, odbywa się to poprzez ograniczenie liczby jedynek w binarnej reprezentacji zbioru tajnych liczb. Doprowadziło to do mniejszej liczby operacji logiki kwantowej niż byłoby to konieczne, co z kolei zmniejszyło ryzyko narastania błędów.

Następnie skompresowali wymagane operacje logiki kwantowej poprzez transpilację, czyli proces przepisywania danych wejściowych tak, aby pasowały do topologii konkretnego urządzenia kwantowego.

Następnie zastosowano metodę zwaną „dynamical decoupling”, która miała największy wpływ na zdolność badaczy do zademonstrowania przyspieszenia kwantowego. Metoda ta polega na stosowaniu sekwencji starannie zaprojektowanych impulsów w celu oddzielenia zachowania kubitu od jego zaszumionego otoczenia i utrzymania przetwarzania kwantowego na właściwym kursie.

Na koniec badacze zastosowali metodę łagodzenia błędów pomiaru (MEM), aby znaleźć i skorygować pewne błędy. Celem tego kroku jest skorygowanie błędów powstałych w wyniku dynamicznego rozdzielania, wynikających z niedoskonałości pomiaru stanu kubitów na końcu algorytmu.

Torowanie drogi do użyteczności kwantowej

Komputery kwantowe oferują znaczące korzyści w takich dziedzinach jak logistyka, materiałoznawstwo, modelowanie finansowe, sztuczna inteligencja i cyberbezpieczeństwo, wykorzystując zjawiska mechaniki kwantowej do rozwiązywania złożonych problemów. Rynek ten odnotowuje znaczący wkład i wzrost.

Społeczność zaczęła również pokazywać, w jaki sposób procesory kwantowe mogą przewyższać swoje klasyczne odpowiedniki w określonych zadaniach.

„Nasze wyniki pokazują, że dzisiejsze komputery kwantowe zdecydowanie plasują się po stronie skalowalnej przewagi kwantowej” – powiedział Lidar, który jest również profesorem chemii i fizyki w USC Dornsife College of Letters, Arts and Science oraz współzałożycielem Quantum Elements, firmy torującej drogę do wykorzystania komputerów kwantowych na dużą skalę i łączącej użytkowników z komputerami kwantowymi.

Kilka miesięcy temu zespół Quantum Elements zgłaszane2 osiągnięcie przełomu. Ich nowatorska technika, logiczne rozdzielenie dynamiczne, rozwiązuje problemy błędów logicznych, które są stałym wyzwaniem w komputerach kwantowych.

Zespół pokazał, w jaki sposób ta konkretna ścieżka zapobiega błędom, których tradycyjne kody korekcji błędów nie potrafią obsłużyć, jednocześnie ograniczając wykorzystanie kubitów.

Połączyli korekcję błędów z logicznym rozdzieleniem dynamicznym, co pozwoliło zespołowi znacznie poprawić dokładność splątanych kubitów logicznych, znacznie przybliżając praktyczne zastosowania kwantowe do stania się rzeczywistością.

Tymczasem, jak twierdzi Lidar, w świetle najnowszych badań „przewaga wydajności kwantowej staje się coraz trudniejsza do zakwestionowania”, ponieważ rozdzielenia wydajności nie da się odwrócić, gdyż zademonstrowany wykładniczy wzrost przyspieszenia jest „bezwarunkowy”.

„The Puzzle of Monogamous Marriage” pokazuje jednoznaczne algorytmiczne przyspieszenie kwantowe dla ograniczonej wersji problemu Hamminga (HW) przy użyciu dwóch różnych procesorów IBM Quantum. Naukowcy odkryli zwiększone przyspieszenie kwantowe, gdy obliczenia są chronione przez DD. Użycie MEM jeszcze bardziej zwiększyło przewagę skalowania.

MEM i sprzężenie dynamiczne zostały użyte do tłumienia błędów i zmodyfikowane w celu dostosowania problemu do rzeczywistych urządzeń kwantowych. Pomogły one utrzymać spójność kwantową i poprawić dokładność pomimo ograniczeń sprzętowych.

Dzięki swoim eksperymentom naukowcy przybliżyli algorytmy NISQ do demonstracji przyspieszenia kwantowego za pomocą algorytmu Shora i podkreślili kluczową rolę, jaką w takiej demonstracji odgrywają techniki tłumienia błędów kwantowych.

Wykazanie wykładniczego przyspieszenia w rozwiązywaniu problemu na rzeczywistym sprzęcie kwantowym, według badaczy, jest „ważnym kamieniem milowym dla tej dziedziny”. Oprócz zasypania luki między teorią a praktyką, ich wyniki podkreślają również rosnące możliwości obecnych procesorów kwantowych. W badaniu zauważono:

„W miarę jak sprzęt się udoskonala, nasze podejście otwiera drogę do jeszcze potężniejszych demonstracji przewagi kwantowej w niedalekiej przyszłości”.

Mimo wszystko nie ma żadnych praktycznych zastosowań tej technologii poza wygrywaniem gier w zgadywanki. Tak było również w przypadku innych postępów w tej dziedzinie.

„Potrzebujemy momentu ChatGPT dla komputerów kwantowych” – powiedział Francesco Ricciuti, wspólnik w firmie VC Runa Capital, w wywiadzie dla CNBC w grudniu, gdy Google zaprezentowało nowy układ, który według firmy oznacza przełom w komputerach kwantowych.

Kwantowy układ Google’a nazywa się Willow i ma 105 kubitów. Podobno może on „wykładniczo” redukować błędy wraz ze wzrostem liczby kubitów. „To rozwiązuje kluczowy problem w kwantowej korekcji błędów, z którym ta dziedzina zmaga się od prawie 30 lat” – powiedział Hartmut Neven, założyciel Google Quantum AI.

Willow wykonał obliczenia, które najszybszym dzisiejszym superkomputerom zajęłyby 10 septylionów lat, w czasie krótszym niż pięć minut.

„Próbują zdefiniować naprawdę trudny problem dla normalnych komputerów, który mogą rozwiązać za pomocą komputerów kwantowych. To niesamowite, że potrafią to zrobić, ale to nie znaczy, że jest to przydatne” – powiedział wówczas Ricciuti.

Nawet Google stwierdziło, że ich test porównawczy RCS „nie ma znanych zastosowań w świecie rzeczywistym”, a „naukowo interesujące symulacje systemów kwantowych”, które zostały przeprowadzone i doprowadziły do nowych odkryć naukowych, również „wciąż znajdują się w zasięgu klasycznych komputerów”.

Gigant technologiczny pracuje jednak nad wejściem w obszar algorytmów, które nie tylko są poza zasięgiem klasycznych komputerów, ale są również „użyteczne w rozwiązywaniu rzeczywistych, istotnych komercyjnie problemów”.

Na początku tego roku Julian Kelly, dyrektor ds. sprzętu w Google Quantum AI, stwierdził, że możemy być „około pięciu lat od prawdziwego przełomu, praktycznego zastosowania, które można rozwiązać tylko na komputerze kwantowym”.

Dyrektor generalny firmy Nvidia, Jensen Huang, również uważa, że komputery kwantowe mogą „przynieść niezwykły wpływ”, ale zauważył, że technologia ta jest „niesamowicie skomplikowana”.

Według Lidara „pozostaje jeszcze wiele do zrobienia, zanim będzie można twierdzić, że komputery kwantowe rozwiązały praktyczny problem ze świata rzeczywistego”. A to wymagałoby przyspieszeń, które nie zależą od wyroczni, które znają odpowiedź z góry. Co więcej, musielibyśmy poczynić znaczące postępy w metodach dalszej redukcji dekoherencji i szumu.

Jednak dzięki wykazaniu wykładniczego przyspieszenia, co wcześniej było jedynie „papierową obietnicą” komputerów kwantowych, naukowcy osiągnęli ważny kamień milowy, co jest warte świętowania.

Inwestowanie w technologię kwantową

Komputery kwantowe stanowią ogromny krok naprzód w dziedzinie możliwości obliczeniowych, dlatego liczne laboratoria, uniwersytety, firmy i agencje rządowe na całym świecie pracują nad technologią komputerów kwantowych.

Jeśli chodzi o możliwości inwestycyjne, mamy Amazon (AMZN ), Intel (INTC ), Microsoft (MSFT ) między innymi aktywnie eksplorujących przestrzeń. Ale dziś przyjrzymy się potencjałowi inwestycyjnemu IBM (IBM ), pioniera w dziedzinie sprzętu kwantowego.

International Business Machines Corporation (IBM )

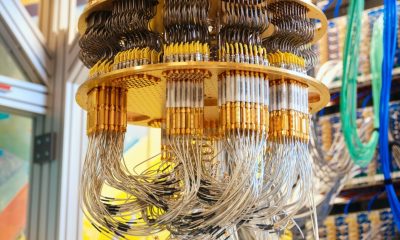

W samym eksperymencie USC wykorzystano 127-kubitowe procesory IBM. Pod koniec listopada 2021 roku IBM po raz pierwszy zaprezentował ten procesor, nazwany Eagle, który był następcą 65-kubitowego procesora „Hummingbird” wprowadzonego na rynek w 2020 roku i 27-kubitowego procesora „Falcon” rok wcześniej.

USC jest w rzeczywistości Centrum Innowacji Quantum IBM, natomiast Quantum Elements jest start-upem w sieci IBM Quantum Network.

W celu skoncentrowania wysiłków w terenie firma ma dedykowaną platformę IBM Quantum, której celem jest zbudowanie pierwszego odpornego na błędy komputera kwantowego na dużą skalę. Gigant technologiczny zamierza dostarczyć system, który dokładnie uruchomi 100 milionów bramek na 200 kubitach logicznych do 2029 r. Dzięki temu systemowi IBM „odblokuje pierwszą realną ścieżkę do realizacji pełnej mocy obliczeń kwantowych”.

IBM buduje ten komputer kwantowy o nazwie „Starling” w swoim nowojorskim kampusie i będzie on obsługiwał głęboki obwód z korekcją błędów. Zgodnie z planem firma planuje również wydanie nowego procesora IBM Quantum Nighthawk w tym roku.

W zeszłym miesiącu wdrożył Quantum System Two w ośrodku badawczym w Japonii. A w tym tygodniu gigant technologiczny wziął udział w rundzie finansowania startupu Qedma o wartości 26 milionów dolarów, a jego dyrektor generalny spodziewa się w tym roku zademonstrować „z przekonaniem, że przewaga kwantowa jest tutaj”. Qedma jest już dostępna za pośrednictwem IBM Qiskit Functions Catalog, który udostępnia kwantowość użytkownikom końcowym.

Choć firma jest liderem w dziedzinie technologii kwantowych, znana jest przede wszystkim ze swojej wiedzy specjalistycznej w zakresie technologii chmury obliczeniowej, sztucznej inteligencji i doradztwa, którą oferuje w segmentach oprogramowania, doradztwa i infrastruktury.

Jeśli spojrzymy na wyniki rynkowe IBM, akcje firmy o kapitalizacji rynkowej 268.6 miliarda dolarów w chwili pisania tego tekstu są notowane po 289 dolarów, co oznacza wzrost o 30.85% od początku roku. Akcje IBM cieszą się dobrym okresem, a ich ceny wzrosły o 145% w ciągu ostatnich trzech lat, osiągając nowe maksima, a firma promuje się jako dostawca technologii korporacyjnych nowej generacji.

Zysk na akcję (TTM) wynosi 5.85, wskaźnik P/E (TTM) 49.81, a wskaźnik ROE (TTM) 21.95%. Tymczasem stopa dywidendy dostępna dla akcjonariuszy jest atrakcyjna i wynosi 2.31%.

(IBM )

Jeśli chodzi o wyniki finansowe, IBM odnotowało 1% wzrost przychodów do 14.5 mld USD w pierwszym kwartale 2025 r. Marża zysku brutto GAAP wyniosła 55.2%, a marża zysku brutto non-GAAP wyniosła 56.6%. Przepływy pieniężne netto z działalności operacyjnej wyniosły 4.4 mld USD, podczas gdy wolne przepływy pieniężne wyniosły 2 mld USD.

Dyrektor generalny Arvind Krishna przypisał przychody, rentowność i wolny przepływ środków pieniężnych przewyższające oczekiwania „silnemu popytowi na generatywną sztuczną inteligencję”, przy czym IBM pozostaje „optymistycznie nastawione do długoterminowych możliwości wzrostu technologii i światowej gospodarki”.

Najnowsze wiadomości i wydarzenia dotyczące akcji IBM

Wniosek

Zademonstrowanie algorytmicznego przyspieszenia kwantowego, takiego, które skaluje się wraz z rozmiarem problemu, jest kluczowe dla ustalenia użyteczności komputerów kwantowych. Tak więc zademonstrowanie bezwarunkowego, wykładniczego przyspieszenia oznacza przełomowy moment w obliczeniach kwantowych, udowadniając, że dzisiejsze urządzenia mogą uwolnić się od klasycznych ograniczeń.

To osiągnięcie badaczy znacząco rozszerza zakres przyspieszeń kwantowych dla algorytmów wyroczni, poszerza granice empirycznych wyników dotyczących przewagi kwantowej i wskazuje, że w końcu można znaleźć w zasięgu ręki algorytmy o znaczeniu praktycznym.

Ogólnie rzecz biorąc, rozwój komputerów kwantowych w kierunku praktycznych, codziennych zastosowań ciągle trwa, a ciągłe udoskonalenia mają na celu uwolnienie pełnej mocy technologii kwantowej!

Kliknij tutaj, aby zapoznać się z listą najlepszych firm zajmujących się komputerami kwantowymi.

Przywoływane badania:

1. Singkanipa, P.; Kasatkin, V.; Zhou, Z.; Quiroz, G.; Lidar, DA Demonstracja algorytmicznego przyspieszania kwantowego dla problemu ukrytej podgrupy abelowej. Fiz. Wersja X 2025, 15 (2), 021082. https://doi.org/10.1103/PhysRevX.15.021082

2. Vezvaee, A.; Tripathi, V.; Morford-Oberst, M.; Butt, F.; Kasatkin, V.; Lidar, DA Demonstracja wierności splątanych kubitów logicznych przy użyciu transmonów. arXiv 2025, arXiv:2503.14472. https://doi.org/10.48550/arXiv.2503.14472